مقایسه شبکههای عصبی کمعمق (SNN) و عمیق (DNN)

خلاصه مقاله

در این مقاله، تفاوتهای کلیدی بین شبکههای عصبی کمعمق (SNN) و عمیق (DNN) مورد بررسی قرار گرفته است. شبکههای عصبی به عنوان مدلهای پیشرفتهای که از ساختار مغز انسان الهام گرفته شدهاند، به دو دسته کمعمق و عمیق تقسیم میشوند. این تفاوتها شامل مواردی همچون معماری، ظرفیت یادگیری، ریسک بیشبرازش، نیازهای دادهای، و تفسیرپذیری است. انتخاب صحیح بین این دو نوع شبکه به عواملی نظیر پیچیدگی وظیفه، حجم دادههای موجود و منابع محاسباتی بستگی دارد.

مقدمه

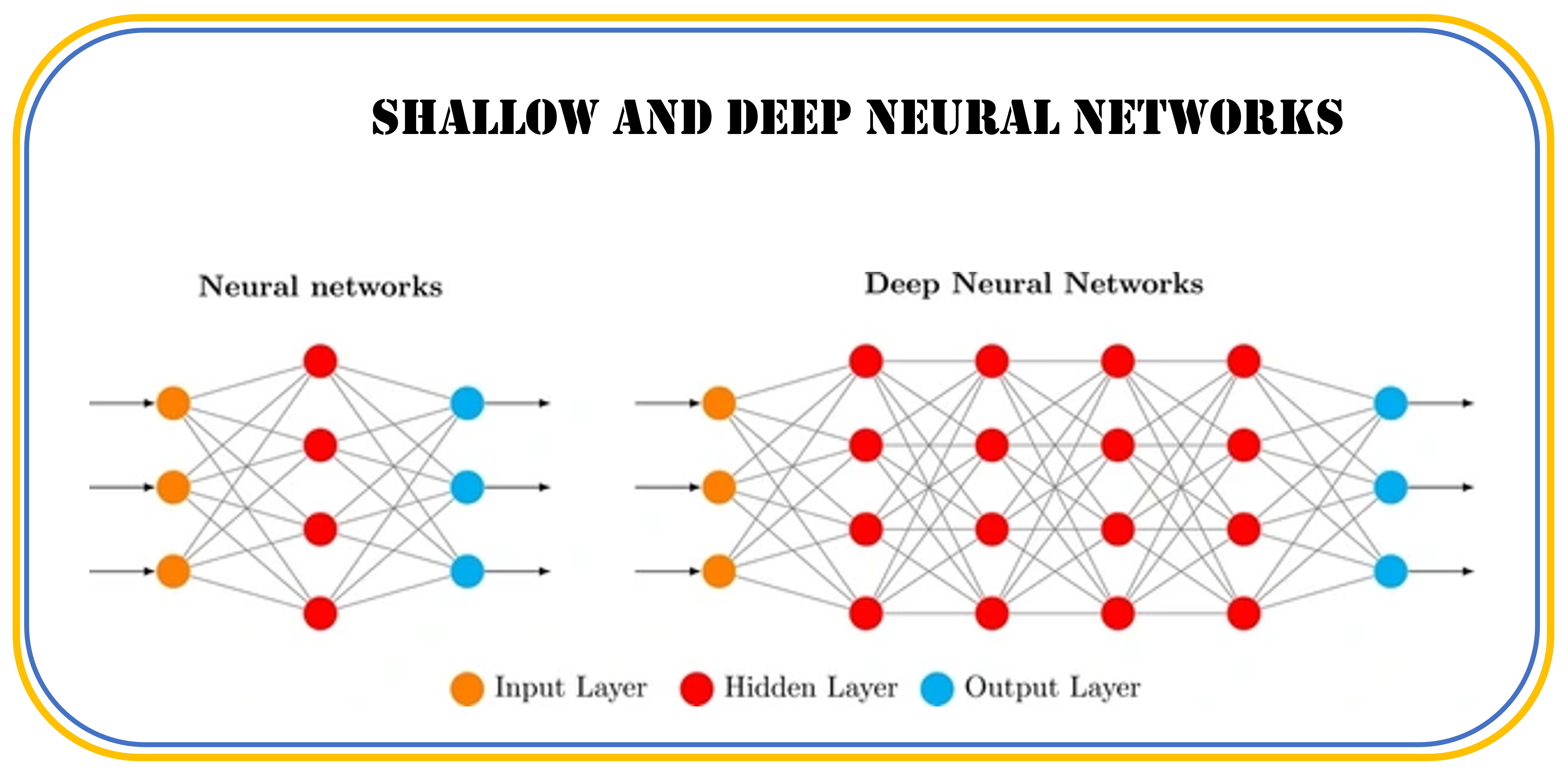

شبکههای عصبی به یکی از اجزای اساسی یادگیری ماشین تبدیل شدهاند که به دلیل قابلیتشان در مدلسازی الگوها و روابط پیچیده در دادهها مورد توجه قرار گرفتهاند. این شبکهها از ساختار مغز انسان الهام گرفته شده و شامل گرهها یا نورونهای متصل به هم هستند که در لایههای مختلف قرار دارند. شبکههای عصبی به طور کلی به دو نوع کمعمق (SNN: Shallow Neural Networks) و عمیق (DNN: Deep Neural Networks) تقسیم میشوند. درک تفاوتهای میان این دو نوع شبکه برای انتخاب مدل مناسب جهت یک وظیفه خاص اهمیت بسیاری دارد.

معماری

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق دارای معماری نسبتاً سادهای هستند. این شبکهها معمولاً شامل سه نوع لایه هستند:

- لایه ورودی: دادههای خام را دریافت میکند.

- لایه پنهان: شامل تنها یک لایه پنهان است که در آن محاسبات و استخراج ویژگیها صورت میگیرد.

- لایه خروجی: خروجی نهایی یا پیشبینی را تولید میکند.

به دلیل تعداد محدود لایههای پنهان، ساختار این شبکهها سادهتر است و پردازش کمتری را میطلبد. از نمونههای کلاسیک شبکههای عصبی کمعمق میتوان به شبکه پرسپترون تکلایه و مدلهای رگرسیون لجستیک اشاره کرد. این شبکهها برای حل مسائل ساده و دادههای کمتر پیچیده مناسب هستند، اما برای مشکلات پیچیده و الگوهای غیرخطی گسترده محدودیتهایی دارند.

شبکههای عصبی عمیق

شبکههای عصبی عمیق، همانطور که از نامشان پیداست، دارای معماری پیچیدهتری هستند که شامل چندین لایه پنهان بین لایههای ورودی و خروجی است. این لایههای اضافی به شبکه امکان میدهند تا ویژگیهای انتزاعیتر و پیچیدهتری را از دادهها بیاموزند. عمق یک شبکه عصبی عمیق به تعداد لایههای پنهانی که در آن قرار دارد اشاره دارد و میتواند از چند لایه محدود تا صدها یا حتی هزاران لایه متغیر باشد.

برخی از انواع رایج شبکههای عصبی عمیق عبارتند از:

- شبکههای عصبی پیچشی (CNN): عمدتاً برای تشخیص تصویر و وظایف بینایی کامپیوتری استفاده میشوند.

- شبکههای عصبی بازگشتی (RNN): برای دادههای ترتیبی نظیر سریهای زمانی یا زبان طبیعی طراحی شدهاند.

درک عمیقتر تفاوتهای این دو نوع شبکه به ما کمک میکند تا با توجه به نیازهای مسأله، شبکه مناسبی را انتخاب کنیم. شبکههای عصبی عمیق با تعداد لایههای بیشتر قادر به یادگیری الگوهای پیچیدهتری هستند، اما این ویژگی میتواند نیاز به دادههای بیشتر و منابع محاسباتی قویتر را به همراه داشته باشد.

پیچیدگی

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق به دلیل معماری سادهتر خود پیچیدگی کمتری دارند. تنها با یک لایه پنهان، این شبکهها میتوانند الگوها و روابط پایهای در دادهها را مدلسازی کنند. این سادگی باعث میشود آموزش آنها آسانتر بوده و کمتر دچار مشکلاتی مانند محوشدگی گرادیان (vanishing gradients) شوند، مشکلی که در شبکههای عمیقتر بیشتر دیده میشود. به همین دلیل، این شبکهها به ویژه برای مسائل ساده و دادههایی که نیاز به پردازش پیچیده ندارند مناسباند.

شبکههای عصبی عمیق

در مقابل، شبکههای عصبی عمیق به دلیل داشتن لایههای پنهان متعدد پیچیدهتر هستند. هر لایه اضافی پارامترهای بیشتری را معرفی میکند و ظرفیت شبکه را برای شناسایی الگوهای پیچیدهتر افزایش میدهد. این افزایش پیچیدگی در بسیاری از موارد منجر به بهبود عملکرد شبکه در انجام وظایف پیچیده میشود، اما به همان اندازه نیز آموزش شبکه را چالشبرانگیزتر میکند. به طور خاص، شبکههای عصبی عمیق مستلزم تنظیم دقیق پارامترها و استفاده از تکنیکهای پیشرفتهتری برای بهینهسازی هستند.

ظرفیت یادگیری

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق دارای ظرفیت یادگیری محدودی هستند. آنها برای وظایفی مناسب هستند که روابط موجود در دادهها نسبتاً ساده یا خطی باشد. به عنوان مثال، این شبکهها در مسائلی مانند طبقهبندی باینری با کلاسهای جداگانه و ساده عملکرد مناسبی دارند، اما در وظایف پیچیدهتر و با الگوهای غیرخطی گستردهتر توانایی کافی را ندارند.

شبکههای عصبی عمیق

شبکههای عصبی عمیق از ظرفیت یادگیری بالاتری برخوردارند. وجود لایههای پنهان متعدد به این شبکهها امکان میدهد که نمایههای سلسلهمراتبی و پیچیدهتری از دادهها ایجاد کنند، که این قابلیت آنها را برای انجام وظایفی که نیاز به درک ویژگیهای پیچیده و انتزاعی دارند، مانند شناسایی تصویر، پردازش گفتار، و درک زبان طبیعی، مناسب میسازد.

ریسک بیشبرازش (Overfitting)

شبکههای عصبی کمعمق

به دلیل تعداد پارامترهای کمتر و معماری سادهتر، شبکههای عصبی کمعمق ریسک کمتری از لحاظ بیشبرازش دارند. بیشبرازش زمانی اتفاق میافتد که یک مدل به جای الگوی اصلی داده، نویز موجود در دادههای آموزشی را یاد بگیرد که این امر باعث کاهش عملکرد مدل در دادههای جدید میشود. از آنجا که شبکههای عصبی کمعمق ظرفیت محدودی برای حفظ دادههای آموزشی دارند، کمتر دچار بیشبرازش میشوند و میتوانند به خوبی به دادههای جدید تعمیم دهند.

شبکههای عصبی عمیق

شبکههای عصبی عمیق به دلیل تعداد بالای پارامترها و لایههای متعدد بیشتر در معرض بیشبرازش هستند. ظرفیت بالای این شبکهها به آنها اجازه میدهد که دادههای آموزشی را با دقت بالا برازش دهند، اما این قابلیت در صورت عدم مدیریت صحیح میتواند منجر به بیشبرازش شود. برای کاهش بیشبرازش در این شبکهها، از تکنیکهایی مانند منظمسازی (regularization)، dropout، و توقف زودهنگام (early stopping) استفاده میشود.

نیازهای دادهای

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق معمولاً برای آموزش موثر به دادههای کمتری نیاز دارند. معماری سادهتر آنها به این معنی است که با تعداد کمتری از نمونههای داده میتوانند الگوها و روابط موجود در داده را بیاموزند. با این حال، این ویژگی محدودیتهایی نیز دارد و توانایی این شبکهها برای پردازش وظایف پیچیده که نیاز به درک عمیقتری از دادهها دارند را کاهش میدهد.

شبکههای عصبی عمیق

در مقابل، شبکههای عصبی عمیق برای آموزش موثر به حجم زیادی از داده نیاز دارند. وجود لایههای متعدد و تعداد بالای پارامترها بدین معناست که این شبکهها به مجموعه دادههای گستردهای نیاز دارند تا بتوانند به خوبی الگوها را بیاموزند و تعمیم دهند. در بسیاری از موارد، عملکرد یک شبکه عصبی عمیق با افزایش اندازه دادههای آموزشی بهبود مییابد و به دادههای بیشتر برای دستیابی به دقت بالاتر نیاز دارد.

تفاوتهای این دو نوع شبکه در پیچیدگی، ظرفیت یادگیری، و نیازهای دادهای، آنها را برای وظایف مختلف مناسب میکند.

تعداد پارامترها

شبکههای عصبی کمعمق

به دلیل تعداد محدود لایههای پنهان، تعداد پارامترها در شبکههای عصبی کمعمق نسبتاً کم است. این تعداد کمتر پارامترها باعث میشود که این شبکهها به حافظه و منابع محاسباتی کمتری نیاز داشته باشند، و در نتیجه، برای وظایف سادهتر کارآمدتر باشند. کاهش تعداد پارامترها همچنین به این معناست که آموزش این شبکهها با سرعت بالاتری انجام میشود.

شبکههای عصبی عمیق

شبکههای عصبی عمیق به دلیل وجود لایههای پنهان متعدد و ارتباطات بین نرونها، تعداد پارامترهای بیشتری دارند. این تعداد پارامترهای بالا نیازمند منابع محاسباتی بیشتری برای آموزش و استنتاج (inference) است. به همین دلیل، برای آموزش بهینه و موثر DNNها اغلب از GPUها یا سایر سختافزارهای تخصصی استفاده میشود تا زمان آموزش به شکل محسوسی کاهش یابد.

منابع محاسباتی

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق نسبت به DNNها به منابع محاسباتی کمتری نیاز دارند. ساختار سادهتر آنها امکان آموزش و استقرار روی پردازندههای استاندارد (CPU) را فراهم میکند و این امر آنها را برای وظایفی که با محدودیت منابع مواجه هستند مناسبتر میسازد. بنابراین، در محیطهایی که منابع سختافزاری محدودند، SNNها انتخاب بهتری محسوب میشوند.

شبکههای عصبی عمیق

آموزش شبکههای عصبی عمیق از نظر محاسباتی بسیار فشرده است، زیرا تعداد بالای پارامترها و پیچیدگی مدل، منابع زیادی را میطلبد. GPUها، TPUها و سایر سختافزارهای خاص برای افزایش سرعت فرآیند آموزش DNNها استفاده میشوند. علاوه بر این، حتی هنگام استقرار برای استنتاج، نیاز به منابع محاسباتی بالایی دارند، که این امر باعث میشود در مواردی که نیاز به پردازش سریع وجود دارد، هزینهبر باشد.

قابلیت تفسیرپذیری

شبکههای عصبی کمعمق

شبکههای عصبی کمعمق به دلیل ساختار سادهتر خود، معمولاً تفسیرپذیری بیشتری دارند. با تنها یک لایه پنهان، درک نحوه پردازش دادههای ورودی و تولید پیشبینیها نسبتاً آسانتر است. این تفسیرپذیری برای کاربردهایی که درک فرآیند تصمیمگیری شبکه اهمیت دارد، مفید است. بنابراین، برای وظایفی که شفافیت و تفسیر دقیق عملکرد مدل مورد نیاز است، شبکههای کمعمق مناسبترند.

شبکههای عصبی عمیق

شبکههای عصبی عمیق اغلب به عنوان "جعبه سیاه" توصیف میشوند، زیرا ساختار پیچیده آنها باعث میشود درک نحوه رسیدن مدل به تصمیمات دشوار باشد. لایههای متعدد و فعالسازیهای غیرخطی موجود در DNNها به این چالش افزوده و تفسیر نتایج مدل را پیچیدهتر میکنند. تکنیکهایی مانند نمایش نقشههای فعالسازی و انتشار مرتبط لایه به لایه به کار گرفته میشوند تا برخی از جنبههای داخلی شبکههای عمیق روشنتر شود، اما همچنان تفسیرپذیری این شبکهها یک چالش عمده باقی مانده است.

این تفاوتهای بنیادین میان SNN و DNN، آنها را برای کاربردهای مختلف مناسب میسازد. در حالی که SNNها به دلیل سادگی و نیازهای منابع کمتر برای مسائل سادهتر مناسبترند، DNNها به دلیل قدرت بالا و ظرفیت یادگیری پیچیدهتر خود، انتخاب بهتری برای وظایف پیشرفتهای مانند شناسایی تصویر و پردازش زبان طبیعی هستند، با این حال، محدودیتهای خاص خود را نیز دارند که نیاز به منابع و قابلیت تفسیرپذیری بیشتر از جمله این محدودیتها است.

مقایسه شبکههای عصبی کمعمق و عمیق

در جدول زیر، برخی از تفاوتهای کلیدی بین شبکههای عصبی کمعمق و عمیق آورده شده است:

شبکههای عصبی کمعمق | شبکههای عصبی عمیق |

شبکه عصبی کمعمق با تعداد کم لایهها (معمولاً یک لایه پنهان) | شبکه عصبی عمیق با لایههای متعدد (چندین لایه پنهان) |

پیچیدگی کم | پیچیدگی زیاد |

ظرفیت یادگیری محدود | ظرفیت یادگیری بالا |

ریسک کمتر بیشبرازش | ریسک بیشتر بیشبرازش |

به داده کمتری نیاز دارد | نیاز به دادههای بیشتر برای آموزش موثر |

تعداد پارامترهای کمتر | تعداد پارامترهای بیشتر |

به منابع محاسباتی کمتری نیاز دارد | نیازمند منابع محاسباتی بیشتر (مانند GPU) |

تفسیرپذیری آسانتر | تفسیرپذیری دشوارتر |

مثال: پرسپترون تکلایه، رگرسیون لجستیک | مثال: شبکههای عصبی کانولوشنی (CNNs)، شبکههای عصبی بازگشتی (RNNs) |

نتیجهگیری

انتخاب بین شبکههای عصبی کمعمق و عمیق به عوامل متعددی بستگی دارد، از جمله پیچیدگی وظیفه، حجم دادههای موجود، و منابع محاسباتی در دسترس. شبکههای عصبی کمعمق برای وظایف سادهتر و دادههای کوچکتر مناسب هستند و با کارایی و تفسیرپذیری بهتری همراهند. از سوی دیگر، شبکههای عصبی عمیق برای حل مسائل پیچیده و با حجم دادههای بزرگ ضروری هستند؛ این شبکهها ظرفیت یادگیری بالاتری را ارائه میدهند، اما نیازمند پیچیدگی و منابع محاسباتی بیشتری هستند. درک این تفاوتها کلیدی است تا بتوان مدل مناسبی را برای یک کاربرد خاص انتخاب کرده و به عملکرد بهینه دست یافت.