الگوریتم جنگل تصادفی

خلاصه مقاله

الگوریتم جنگل تصادفی یکی از روشهای محبوب و قدرتمند در یادگیری ماشین است که با ترکیب چندین درخت تصمیم و استفاده از اصول تصادفیسازی، دقت و پایداری مدل را افزایش میدهد. این الگوریتم از سه اصل اصلی نمونهگیری تصادفی از دادهها، انتخاب تصادفی ویژگیها، و ترکیب نتایج درختها استفاده میکند تا مشکلات رایج مانند بیشبرازش را کاهش دهد. ا این حال، چالشهایی مانند سرعت پایین در دادههای بزرگ، دشواری تفسیر نتایج، و نیاز به تنظیم دقیق پارامترها از محدودیتهای آن محسوب میشوند.

مقدمه

در دهههای اخیر، یادگیری ماشین به یکی از مهمترین ابزارها برای تحلیل دادهها و تصمیمگیری در حوزههای مختلف علمی و صنعتی تبدیل شده است. یکی از الگوریتمهای برجسته در این زمینه، جنگل تصادفی (Random Forest) است که به دلیل دقت بالا، انعطافپذیری، و توانایی مدیریت دادههای پیچیده، به یکی از محبوبترین روشها در یادگیری ماشینی تبدیل شده است. این الگوریتم، که بر پایه ترکیب چندین درخت تصمیم عمل میکند، از اصول تصادفیسازی برای بهبود عملکرد و کاهش مشکلات رایج مانند بیشبرازش (Overfitting) استفاده میکند.

در این مقاله، ابتدا به توضیح مفهوم جنگل تصادفی و اجزای اصلی آن، یعنی درختهای تصمیم، پرداخته میشود. سپس، تاریخچه توسعه این الگوریتم، مکانیزم عملکرد آن، کاربردها، مزایا، و معایب آن بررسی میشوند.

مفهوم جنگل تصادفی

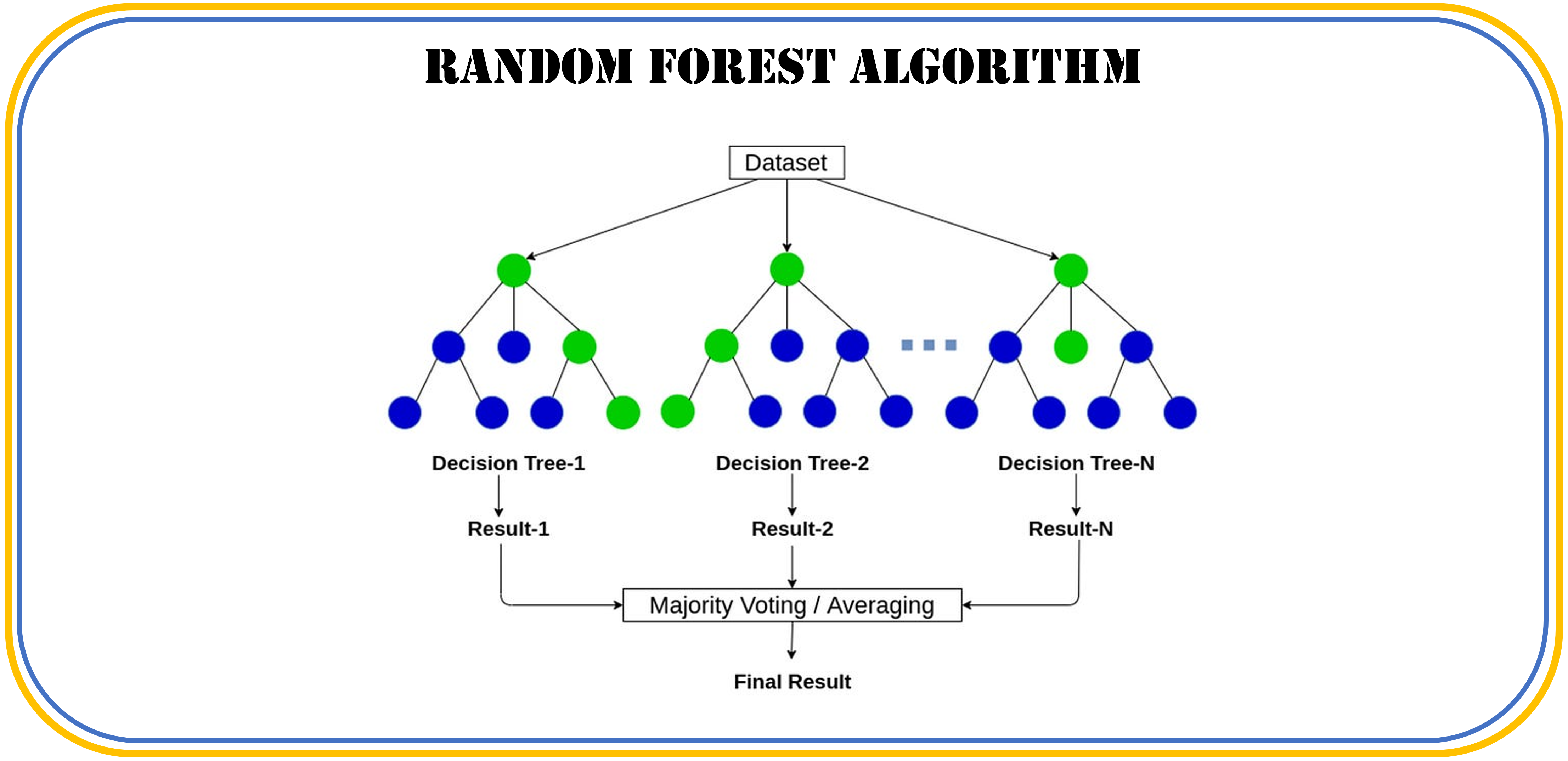

برای درک بهتر الگوریتم جنگل تصادفی، میتوان آن را به یک فرآیند تصمیمگیری جمعی تشبیه کرد. فرض کنید برای تصمیمگیری درباره یک موضوع پیچیده، مانند پیشبینی وضعیت آبوهوا، به جای اعتماد به نظر یک فرد، از گروهی از کارشناسان مختلف نظرخواهی میکنید. هر کارشناس بر اساس دانش و تجربه خود پاسخی ارائه میدهد، و در نهایت، با جمعبندی نظرات (مثلاً از طریق رایگیری یا میانگینگیری)، تصمیم نهایی گرفته میشود. جنگل تصادفی نیز به همین شکل عمل میکند، با این تفاوت که به جای کارشناسان انسانی، از مجموعهای از درختهای تصمیم استفاده میکند.

جنگل تصادفی یک روش یادگیری ماشینی از نوع یادگیری اجماعی (Ensemble Learning) است که از تعداد زیادی درخت تصمیم تشکیل شده است. هر درخت تصمیم به طور مستقل به یک مسئله پاسخ میدهد، و سپس پاسخهای همه درختها با استفاده از روشهای آماری (مانند رایگیری برای مسائل دستهبندی یا میانگینگیری برای مسائل پیشبینی عددی) ترکیب میشوند تا نتیجه نهایی به دست آید. این رویکرد، با ایجاد تنوع در درختها و کاهش وابستگی به دادههای خاص، دقت و پایداری مدل را افزایش میدهد.

درخت تصمیم: پایه و اساس جنگل تصادفی

برای درک بهتر جنگل تصادفی، ابتدا باید با مفهوم درخت تصمیم آشنا شویم. درخت تصمیم یک مدل یادگیری ماشین است که فرآیند تصمیمگیری را به صورت سلسلهمراتبی و بر اساس ویژگیهای دادهها مدلسازی میکند. به عنوان مثال، فرض کنید میخواهیم تصمیم بگیریم که آیا در یک روز خاص باید چتر به همراه داشته باشیم یا خیر. ممکن است فرآیند تصمیمگیری به این شکل باشد:

- اگر آسمان ابری است، احتمال بارندگی زیاد است.

- اگر علاوه بر ابر، باد شدید میوزد، احتمال بارندگی شدیدتر است.

- اگر دما پایین باشد، باران ممکن است سرد و ناخوشایند باشد.

این فرآیند تصمیمگیری به صورت یک درخت نمایش داده میشود: از یک سوال اولیه (مانند "آیا آسمان ابری است؟") شروع میشود و بسته به پاسخ، به شاخههای بعدی هدایت میشود. در یادگیری ماشینی، درخت تصمیم همین رویکرد را برای تحلیل دادهها به کار میگیرد. دادهها بر اساس ویژگیهای مختلف (مانند دما، رطوبت، یا سرعت باد) بررسی میشوند، و مدل بر اساس این ویژگیها تصمیمگیری میکند.

با این حال، درخت تصمیم به تنهایی دارای محدودیتهایی است. این مدل ممکن است به دلیل وابستگی بیش از حد به دادههای آموزشی، دچار بیشبرازش شود، یعنی عملکرد خوبی روی دادههای آموزشی داشته باشد، اما روی دادههای جدید (دادههای آزمایش) ضعیف عمل کند. همچنین، درخت تصمیم ممکن است به نویز (Noise) یا تغییرات کوچک در دادهها حساس باشد. اینجاست که جنگل تصادفی با ترکیب چندین درخت تصمیم و استفاده از اصول تصادفیسازی، این مشکلات را برطرف میکند.

مکانیزم عملکرد جنگل تصادفی

جنگل تصادفی بر پایه سه اصل اساسی عمل میکند که در ادامه توضیح داده میشوند:

1. استفاده از نمونههای تصادفی از دادهها (Bootstrap Sampling):

به جای اینکه همه درختها از کل مجموعه دادههای آموزشی استفاده کنند، هر درخت از یک زیرمجموعه تصادفی از دادهها (که با روش نمونهگیری با جایگذاری یا Bootstrap انتخاب میشود) یاد میگیرد. این فرآیند باعث میشود که هر درخت دیدگاه متفاوتی داشته باشد و تنوع در مدلها افزایش یابد.

2. انتخاب تصادفی ویژگیها (Feature Subsampling):

در هر مرحله از ساخت درخت تصمیم، به جای استفاده از تمام ویژگیهای موجود، تنها زیرمجموعهای تصادفی از ویژگیها برای تصمیمگیری انتخاب میشود. به عنوان مثال، اگر دادهها شامل ویژگیهای دما، رطوبت، و سرعت باد باشند، ممکن است یک درخت فقط از دما و رطوبت برای تصمیمگیری استفاده کند. این رویکرد باعث کاهش همبستگی بین درختها و افزایش تنوع مدل میشود.

3. ترکیب نتایج (Aggregation):

پس از ساخت همه درختها، پاسخهای آنها برای تصمیمگیری نهایی ترکیب میشوند. در مسائل دستهبندی (Classification)، از روش رایگیری اکثریت (Majority Voting) استفاده میشود، به این معنا که دستهای که بیشترین رای را از درختها دریافت کند، به عنوان نتیجه نهایی انتخاب میشود. در مسائل پیشبینی عددی (Regression)، میانگین پیشبینیهای درختها محاسبه میشود.

این سه اصل، یعنی نمونهگیری تصادفی، انتخاب تصادفی ویژگیها، و ترکیب نتایج، باعث میشوند که جنگل تصادفی نسبت به یک درخت تصمیم منفرد، دقت بالاتر و پایداری بیشتری داشته باشد.

تاریخچه و توسعه جنگل تصادفی

ایده اولیه استفاده از چندین مدل برای بهبود عملکرد پیشبینی، به دهه ۱۹۹۰ بازمیگردد. در این دوره، روشهای یادگیری اجماعی مانند Bagging (Bootstrap Aggregating) توسط پژوهشگرانی مانند Leo Breiman معرفی شدند. با این حال، نسخه مدرن و شناختهشده جنگل تصادفی در سال ۲۰۰۱ توسط Breiman ارائه شد. او در مقالهای که در مجله Machine Learning منتشر شد، نشان داد که با ترکیب تعداد زیادی درخت تصمیم و استفاده از تصادفیسازی در انتخاب دادهها و ویژگیها، میتوان دقت پیشبینی را به طور قابل توجهی افزایش داد و در عین حال از بیشبرازش جلوگیری کرد.

بیشبرازش یکی از مشکلات رایج در یادگیری ماشین است که زمانی رخ میدهد که مدل بیش از حد به جزئیات دادههای آموزشی وابسته میشود و نمیتواند روی دادههای جدید عملکرد خوبی داشته باشد. جنگل تصادفی با ایجاد تنوع در درختها و کاهش وابستگی به دادههای خاص، این مشکل را تا حد زیادی برطرف میکند. از زمان معرفی این الگوریتم، پژوهشهای متعددی برای بهبود عملکرد آن و گسترش کاربردهایش انجام شده است.

کاربردهای جنگل تصادفی

جنگل تصادفی به دلیل انعطافپذیری و دقت بالا، در حوزههای متنوعی مورد استفاده قرار گرفته است. در ادامه، برخی از مهمترین کاربردهای این الگوریتم ذکر شدهاند:

1. پزشکی و سلامت:

جنگل تصادفی برای تحلیل دادههای پزشکی، مانند تشخیص بیماریها بر اساس علائم بیمار یا نتایج آزمایشگاهی، بسیار موثر است. به عنوان مثال، این الگوریتم میتواند برای تشخیص زودهنگام بیماریهایی مانند سرطان یا دیابت استفاده شود.

2. بانکداری و امور مالی:

در صنعت بانکداری، جنگل تصادفی برای پیشبینی ریسک اعتباری، مانند احتمال بازپرداخت وام توسط مشتریان، به کار میرود. همچنین، این الگوریتم برای تشخیص تقلب در تراکنشهای مالی استفاده میشود.

3. کشاورزی و محیطزیست:

در کشاورزی، جنگل تصادفی برای پیشبینی میزان محصول، تشخیص آفات گیاهی، یا تحلیل دادههای خاک و آب استفاده میشود. در حوزه محیطزیست، این الگوریتم برای پیشبینی تغییرات آبوهوایی یا تحلیل دادههای زیستمحیطی کاربرد دارد.

4. پردازش تصویر و بینایی ماشین:

جنگل تصادفی در شناسایی اشیاء در تصاویر، مانند تشخیص چهره، خودروها، یا اشیاء دیگر، عملکرد خوبی دارد. این الگوریتم همچنین در تحلیل تصاویر پزشکی، مانند تصاویر MRI یا CT، استفاده میشود.

5. پیشبینی و تحلیل دادههای زمانی:

در حوزههایی مانند پیشبینی قیمت سهام، تحلیل دادههای هواشناسی، یا پیشبینی تقاضا در بازار، جنگل تصادفی به دلیل توانایی مدیریت دادههای پیچیده و غیرخطی، مورد توجه قرار گرفته است.

مزایای جنگل تصادفی

جنگل تصادفی به دلیل ویژگیهای منحصربهفرد خود، یکی از محبوبترین الگوریتمهای یادگیری ماشین است. برخی از مهمترین مزایای آن عبارتند از:

1. دقت بالا:

استفاده از تعداد زیادی درخت تصمیم و ترکیب نتایج آنها، دقت پیشبینی را به طور قابل توجهی افزایش میدهد.

2. مقاومت در برابر بیشبرازش:

به دلیل تنوع در درختها و استفاده از نمونههای تصادفی، جنگل تصادفی کمتر دچار بیشبرازش میشود و روی دادههای جدید عملکرد خوبی دارد.

3. انعطافپذیری:

این الگوریتم هم برای مسائل دستهبندی (مانند تشخیص بیماری) و هم برای مسائل پیشبینی عددی (مانند پیشبینی قیمت) قابل استفاده است.

4. مدیریت دادههای ناقص:

جنگل تصادفی میتواند با دادههای ناقص یا گمشده به خوبی کار کند، زیرا هر درخت از بخشی از دادهها استفاده میکند و وابستگی به کل دادهها ندارد.

5. ارزیابی اهمیت ویژگیها:

یکی از ویژگیهای مهم جنگل تصادفی، توانایی آن در شناسایی ویژگیهای مهم در پیشبینی است. این قابلیت برای تحلیل دادهها و انتخاب ویژگیهای کلیدی بسیار مفید است.

معایب و چالشهای جنگل تصادفی

با وجود مزایای متعدد، جنگل تصادفی نیز مانند هر الگوریتم دیگری دارای محدودیتهایی است. برخی از مهمترین معایب آن عبارتند از:

1. سرعت پایین در دادههای بزرگ:

ساخت و ارزیابی تعداد زیادی درخت تصمیم، به ویژه در مجموعه دادههای بزرگ، میتواند زمانبر باشد و نیاز به منابع محاسباتی بالایی داشته باشد.

2. نیاز به تنظیم دقیق پارامترها:

عملکرد جنگل تصادفی به پارامترهایی مانند تعداد درختها، عمق هر درخت، و تعداد ویژگیهای انتخابشده بستگی دارد. تنظیم نادرست این پارامترها ممکن است به کاهش عملکرد منجر شود.

3. دشواری در تفسیر نتایج:

برخلاف یک درخت تصمیم منفرد که به راحتی قابل تفسیر است، جنگل تصادفی به دلیل پیچیدگی و تعداد زیاد درختها، مانند یک جعبه سیاه عمل میکند و فهمیدن دلیل تصمیمگیری آن دشوار است.

4. مصرف منابع محاسباتی:

در مقایسه با الگوریتمهای سادهتر، جنگل تصادفی به دلیل نیاز به ساخت چندین مدل، منابع محاسباتی بیشتری مصرف میکند.

نتیجهگیری

جنگل تصادفی یکی از قدرتمندترین و انعطافپذیرترین الگوریتمهای یادگیری ماشین است که با ترکیب چندین درخت تصمیم و استفاده از اصول تصادفیسازی، دقت بالا و پایداری قابل توجهی ارائه میدهد. این الگوریتم در حوزههای متنوعی مانند پزشکی، بانکداری، کشاورزی، و پردازش تصویر کاربرد دارد و به دلیل توانایی مدیریت دادههای پیچیده و ناقص، مورد توجه پژوهشگران و متخصصان قرار گرفته است.

با این حال، چالشهایی مانند سرعت پایین در دادههای بزرگ، دشواری تفسیر نتایج، و نیاز به تنظیم دقیق پارامترها، از جمله محدودیتهای این الگوریتم هستند. پژوهشهای اخیر نشاندهنده تلاش برای رفع این محدودیتها و گسترش کاربردهای جنگل تصادفی هستند. جنگل تصادفی نه تنها برای متخصصان، بلکه برای همه کسانی که به دنبال حل مسائل پیچیده با استفاده از دادهها هستند، یک ابزار ارزشمند و کارآمد است.